- L'introduzione di modelli come GPT-3 ha reso i chatbot capaci di dialogare in modo naturale.

- I comportamenti emergenti consentono ai modelli di superare abilità previste, come la traduzione efficace.

- Le allucinazioni possono portare a errori significativi, con rischi legali per le aziende, come avvenuto con un caso di musica IA su Reddit.

L’intelligenza artificiale (IA) ha ormai permeato ogni aspetto della nostra vita quotidiana, trasformando il modo in cui le aziende operano e interagiscono con i clienti. La svolta è avvenuta con l’introduzione di modelli linguistici avanzati, come GPT-3 di OpenAI, che hanno reso possibile la creazione di chatbot conversazionali capaci di dialogare in modo naturale con gli esseri umani. Questa tecnologia ha aperto nuove prospettive, ma ha anche sollevato preoccupazioni riguardo alla privacy e alla sicurezza dei dati. In Italia, il Garante della privacy ha già iniziato a esaminare l’uso di tali strumenti, evidenziando la necessità di un quadro normativo adeguato.

Un aspetto intrigante dell’IA è rappresentato dai cosiddetti comportamenti emergenti. Questi si manifestano quando i modelli linguistici di grandi dimensioni superano una certa soglia di complessità, acquisendo abilità non previste dai loro creatori. Tali abilità possono includere la capacità di tradurre testi in modo efficace o di risolvere problemi complessi attraverso un’analisi logica. Tuttavia, l’IA non è infallibile e può incorrere in errori noti come allucinazioni, dove il sistema genera risposte incoerenti o inesatte.

Il Fenomeno delle Allucinazioni dell’IA

Le allucinazioni dell’IA rappresentano un fenomeno complesso e affascinante. Queste si manifestano quando un sistema di linguaggio sofisticato, come un chatbot generativo, interpreta schemi che non esistono realmente, generando risposte prive di senso. Un esempio emblematico è stato riportato su Reddit, dove un generatore di musica basato su IA ha iniziato a emettere suoni simili a un pianto umano, lasciando perplessi gli utenti. Questo comportamento potrebbe derivare da un tentativo dell’IA di imitare elementi emotivi presenti nelle canzoni umane, ma il risultato è stato un’interpretazione errata e disturbante.

Gli stati di allucinazione possono portare a effetti rilevanti, soprattutto nei settori legale e sanitario. Ad esempio, un sistema IA impiegato nel campo medico potrebbe identificare una problematica innocua come pericolosa, conducendo a procedure non richieste. Inoltre, nel caso in cui l’IA venga formata su dati con pregiudizi, potrebbe produrre risultati condizionati da questi stereotipi, mettendo le aziende a rischio di azioni legali per discriminazione o diffuse falsità.

- 🌟 L'IA trasforma il business e migliora le......

- ⚠️ Attenzione ai rischi legali con IA allucinante......

- 🔍 Scopri come le allucinazioni dell'IA potrebbero rivoluzionare......

Implicazioni Legali e Etiche dell’Intelligenza Artificiale

L’uso dell’IA comporta una serie di sfide legali ed etiche che non possono essere ignorate. Le allucinazioni possono portare a errori significativi, con potenziali ripercussioni legali per le aziende. Ad esempio, un sistema IA che analizza le recensioni dei clienti potrebbe generare raccomandazioni inappropriate, danneggiando la reputazione dell’azienda e portando a cause legali per pubblicità ingannevole. Inoltre, un sistema di gestione degli stock basato su IA potrebbe fare previsioni errate, causando problemi di approvvigionamento e perdite finanziarie.

Per mitigare questi rischi, è fondamentale utilizzare dati di addestramento di alta qualità e definire chiaramente lo scopo del modello IA. La supervisione umana è cruciale per esaminare e aggiustare i risultati dell’IA, assicurando che eventuali allucinazioni vengano filtrate e rettificate. Inoltre, è importante considerare le implicazioni etiche dell’uso dell’IA, assicurandosi che le tecnologie siano utilizzate in modo responsabile e conforme alla legge.

Conclusioni e Riflessioni sul Futuro dell’IA

L’intelligenza artificiale continua a evolversi, offrendo nuove opportunità e sfide. Le allucinazioni rappresentano un aspetto critico da considerare, poiché possono influenzare la precisione e l’affidabilità dei sistemi IA. Per le aziende, è essenziale comprendere i rischi legali e le responsabilità etiche associate all’uso di queste tecnologie. Collaborare con esperti legali e tecnologici può aiutare a navigare questo complesso panorama, garantendo un uso sicuro e conforme dell’IA.

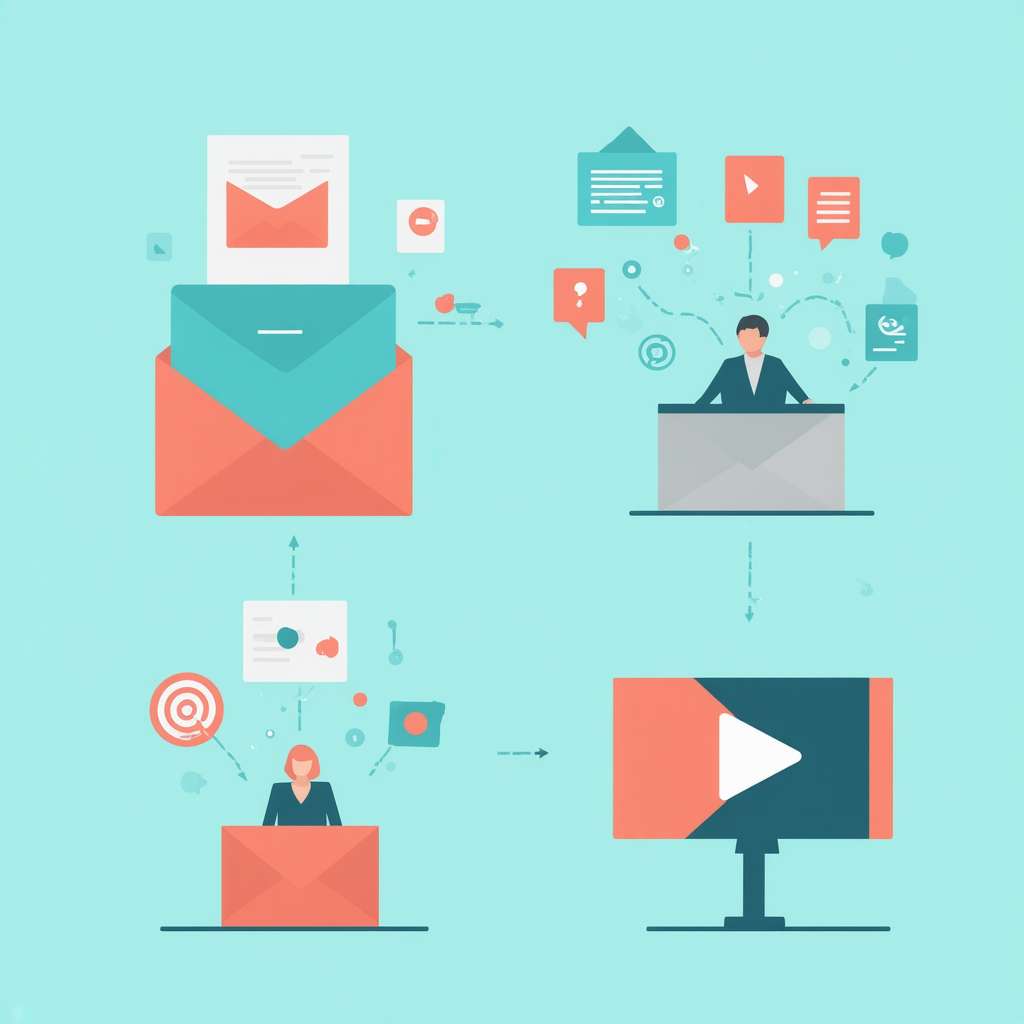

In termini di SEO e social marketing, una nozione fondamentale è l’importanza di creare contenuti di qualità che rispondano alle esigenze degli utenti. L’IA può essere uno strumento potente per generare contenuti pertinenti e coinvolgenti, ma è essenziale monitorare attentamente gli output per evitare errori e garantire l’accuratezza delle informazioni.

Un aspetto avanzato del SEO e social marketing è l’ottimizzazione dei contenuti per la ricerca vocale. Con l’aumento dell’uso degli assistenti vocali, è importante adattare i contenuti per rispondere alle query vocali, che tendono a essere più conversazionali e basate su domande. L’IA può aiutare a identificare le tendenze emergenti nella ricerca vocale e a ottimizzare i contenuti di conseguenza.

Riflettendo su questi temi, emerge l’importanza di un approccio equilibrato e consapevole all’uso dell’IA. Mentre la tecnologia offre enormi potenzialità, è essenziale considerare le implicazioni etiche e legali, garantendo che l’adozione dell’IA sia guidata da principi di responsabilità e trasparenza.